La Inteligencia Artificial (IA) es una tecnología clave para el futuro de Europa. Su impacto trasciende sectores y fronteras al impulsar la productividad, mejorar los servicios públicos, reforzar la sostenibilidad y acelerar la innovación.

Europa ha apostado por una IA centrada en las personas, segura, ética y alineada con los valores del Estado de Derecho. El nuevo Reglamento Europeo de IA y la política industrial digital sientan las bases para convertir a Europa en un auténtico “AI Continent”, donde la innovación y la confianza avanzan de la mano.

Las telecomunicaciones son la base del desarrollo y la adopción de la IA. Con el enfoque “Telco for AI”, los operadores proporcionan la conectividad, los datos y la capacidad de computación que hacen posible entrenar, desplegar y escalar soluciones de IA de forma segura y sostenible.

A la vez, con “AI for Telco”, la propia IA transforma las redes, haciéndolas más inteligentes, automatizadas y eficientes.

Esta doble visión sitúa a las telcos en el corazón del nuevo ecosistema digital europeo, impulsando una IA confiable, responsable y centrada en las personas.

Una visión europea de futuro

La Inteligencia Artificial es un pilar de la nueva política industrial europea, orientada a reforzar las capacidades tecnológicas del continente y garantizar una transición digital justa y sostenible.

Para que Europa lidere esta transformación, es clave invertir, innovar y aplicar la IA con propósito, acelerando su adopción en todos los sectores económicos.

Inteligencia Artificial e IA Generativa

Posicionamiento 2024.

Inteligencia Artificial

Innovación, ética y regulación.

Principios y modelo de gobernanza de la IA en Telefónica

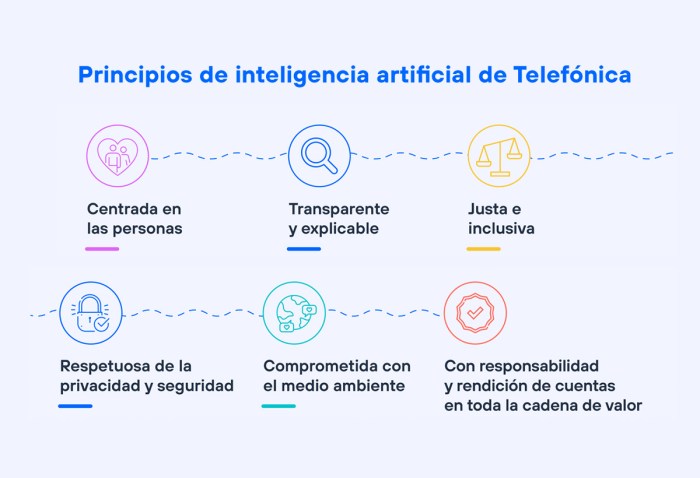

Telefónica aprobó unos principios éticos para la IA de aplicación en toda la compañía. Estos principios se aplican desde el diseño y abarca su desarrollo incluyendo el uso de productos y servicios por parte de los empleados de la compañía, así como los proveedores y terceras partes.

- RECURSO RELACIONADOInfografía: Nuestros principios de IAPDF | 497 KB

Nuestro modelo de gobierno de la IA, aprobado en 2023, define procesos y responsabilidades claras para aprovechar todo su potencial, proteger a las personas y minimizar riesgos en cada fase del ciclo de vida de los sistemas de inteligencia artificial: desde el diseño y desarrollo hasta su adquisición, comercialización y uso.

Nuestros principios de IA y modelo de gobierno aplican a todos nuestros productos y servicios desde el diseño y se extiende a nuestros proveedores y socios comerciales. Además, nos va a permitir cumplir con las leyes de IA aplicables en cada uno de los países en los que operamos.